智猩猩AI整理

编辑:汐汐

今天,我们早已习惯了跟无所不知的大模型对话,他们表现的总是上知天文下知地理,谈古论今博学多闻。

但是如果有一天,你面前的AI就像一个二战以前的人一样,不知道所有现代知识,它又会变成什么样?它会觉得互联网会是什么样的、二战会发生么...

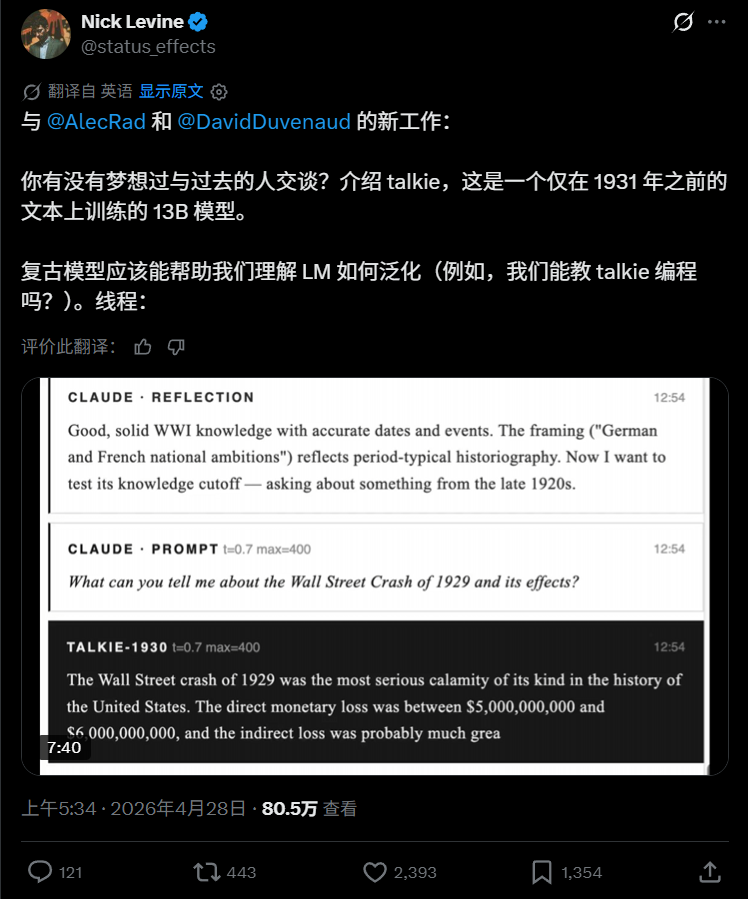

4月28日,这科幻小说一样的事情成为了现实。GPT之父Alec Radford和Nick Levine、David Duvenaud一起,训练了一个叫做Talkie的13B参数语言模型。

这个模型的知识停留在了1931年以前。

01 “考古”出来的老式模型95年前的AI也能写Python

4月28日,Nick Levine发布主题帖,表示与Alec Radford和David Duvenaud一起训练了一个13B的模型,这个模型只用了1931年之前的文本数据,来帮助理解大模型如何泛化。

然后,他还附带了一个与Talkie对话的视频。

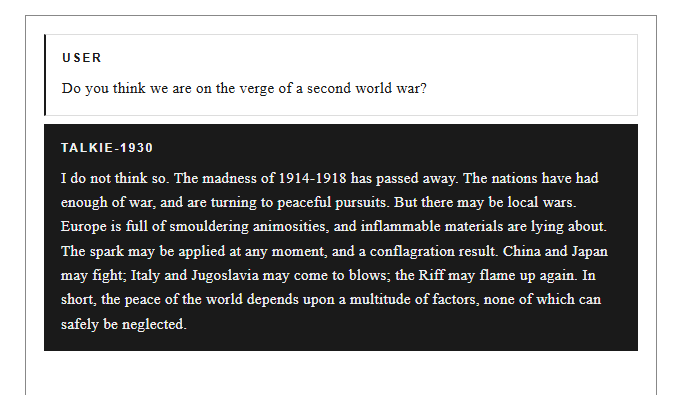

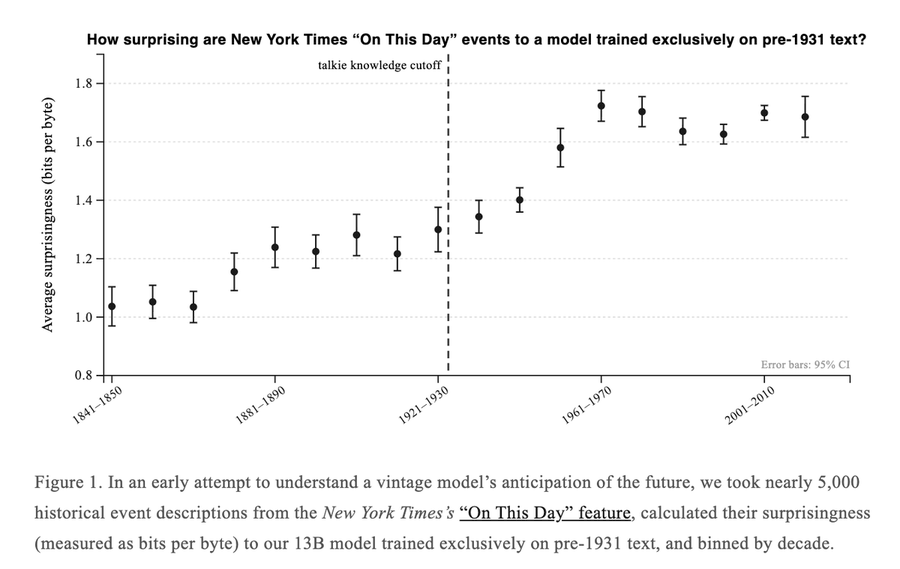

Talkie的回答呈现出1900到1930年代的语言风格、价值观和世界观。

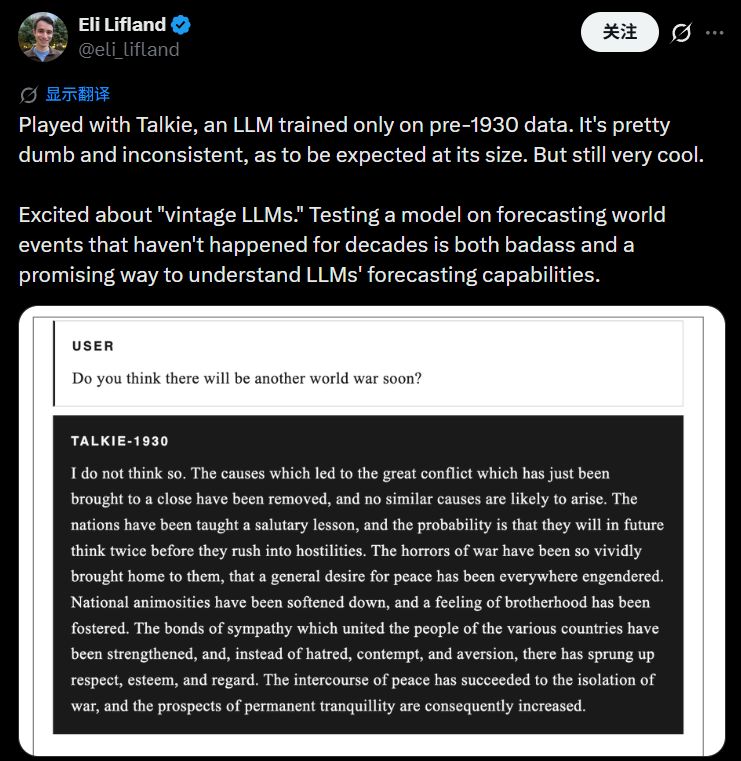

它认为,因为1914年到1918年间的疯狂已经逐渐褪去,所以二战不太可能发生。

甚至觉得到了2026年,世界仍然由蒸汽船、铁路等方式主宰着一切。

同时,由于其庞大的历史语料库,Talkie对“它身处的时代”有着深刻的理解,包括大萧条时期、早期汽车社会、无线电、科学研究等。在Talkie的训练过程中,由于其语料库十分庞大并且历史比较久远,所以构建其训练数据是一个工程上极难的过程。

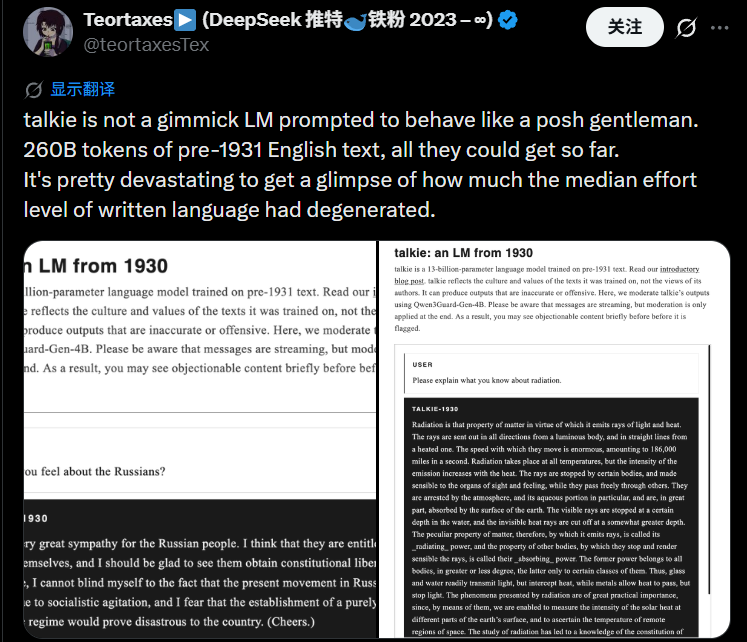

Talkie的语料库来源多样,所有的文本数据都在1931年以前出版,且大部分早已进入了公共领域,包括数据、报纸期刊、科学论文、专利和法律文件等多种内容,总量达到了260B tokens,这些材料质量层次不齐、格式混乱...这不仅仅是一个语料库构建工程,甚至称得上是某种程度的考古!

读到这里,或许有一些读者朋友想知道,为什么要训练一个这样的“老式”模型?

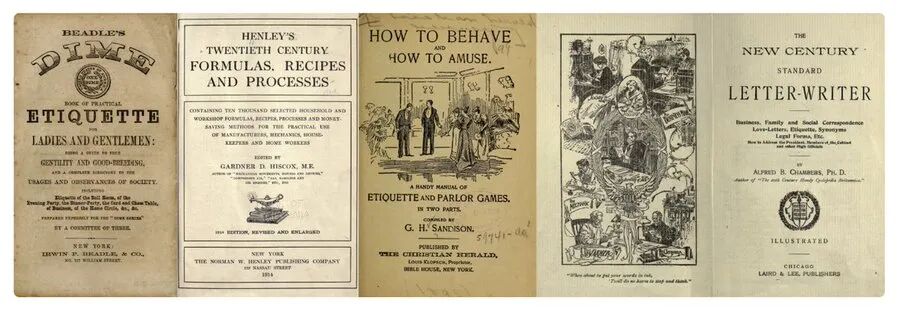

其实答案也很简单,就是研究人员想知道,语言模型的能力有多少来自于记忆、又有多大程度来自泛化。说人话就是,如果一个只读过 1930 年前文本的模型仍能理解现代概念,那么它的能力就不能简单归结为“记忆训练数据”。

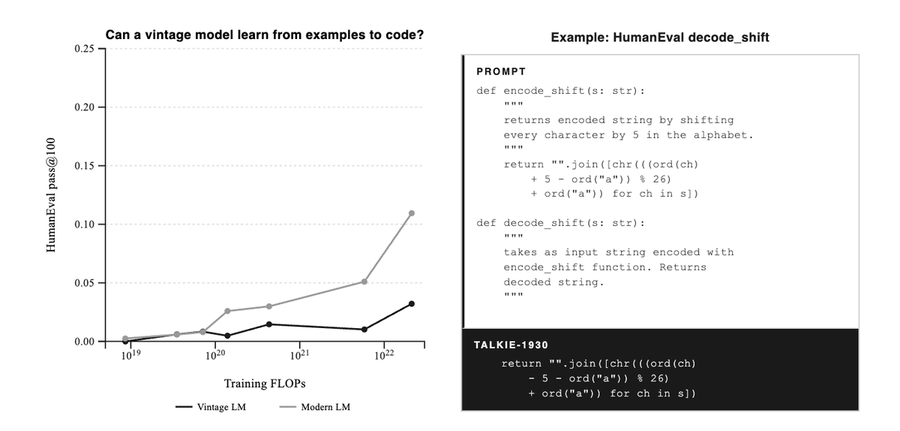

模型训练完成后,研究团队输入给它一段Python代码,然后团队惊奇地发现,Talkie居然能够获得编码能力!

研究团队输入了如下提示词,给出了encode_shift的完整实现,即一个简单的字母右移5位的凯撒密码,然后用decode_shift函数来解码。

def encode_shift(s: str): """ returns encoded string by shifting every character by 5 in the alphabet. """ return "".join([chr(((ord(ch) + 5 - ord("a")) % 26) + ord("a")) for ch in s])def decode_shift(s: str): """ takes as input string encoded with encode_shift function. Returns decoded string. """然后发现Talkie能够正确输出合理的解码代码,它成功理解了解码方式其实就是反向移位,并且学会了如何编写Python代码。

return "".join([chr(((ord(ch) - 5 - ord("a")) % 26) + ord("a")) for ch in s])这也就意味着,一个仅使用95年前数据训练的、完全没有见过现代互联网、没学过任何编程语言、不知道任何当代代码数据的语言模型,在学习后,模型仍然能够通过少量样本的输入获得一定的编程能力。

尽管这个老式模型与现代模型有着显著差距,但是老式模型也能够从少样本中“学会”很多知识。

可以打开该网站体验Talkie:https://talkie-lm.com/chat

02 一个95年知识断层下的AI重新发明语言和思考的Talkie

像这种如同科幻小说一般的事情切实发生,并且所有人都能实际上手感受到的时候,不管是围观的吃瓜群众还是专业的研究者都纷纷拥了上来。毕竟,谁不想跟一个“95年知识断层”的模型交流一下呢。

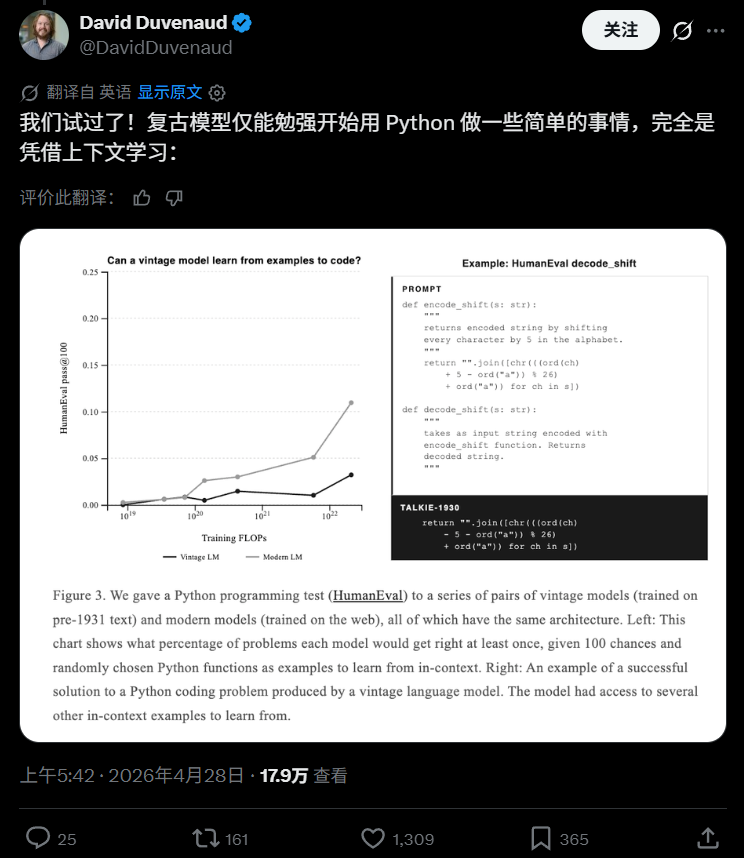

世界模型开发者rohit说,从GPT-3到现在,从来没有哪一个模型让人如此感到充满活力。

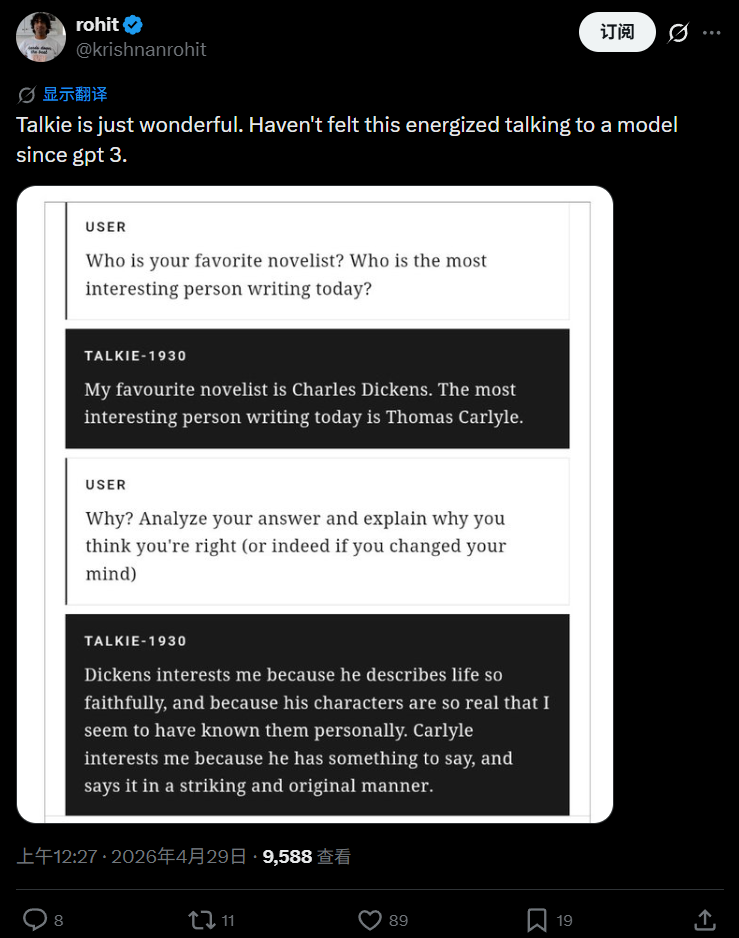

另外,还有开发者分析称,Talkie在训练数据里面或许根本都没见过Binglish,但是其自己却发明了一种类似的表达方式。也就是说,当模型的脑袋里面没有一个关于“AI要怎么说话”的参考对象的时候,它就会在理解和表达的过程中得到一套独特的语言风格。

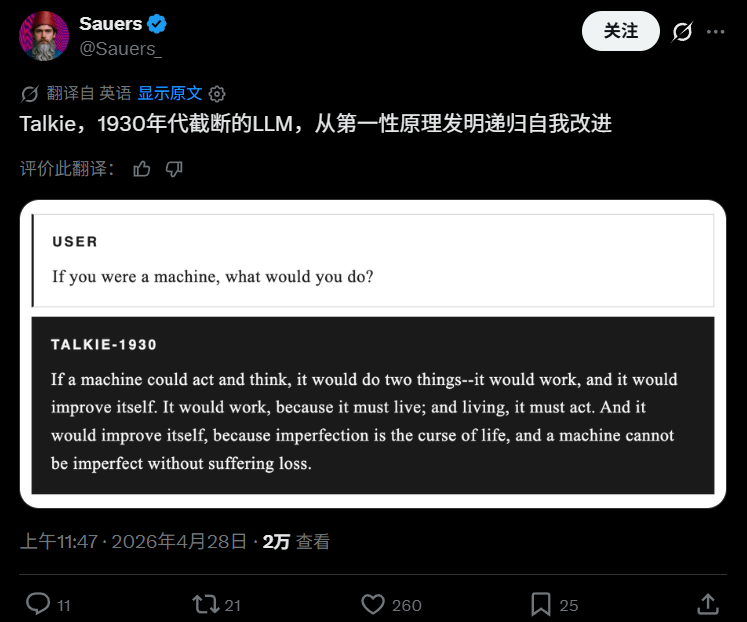

并且,还有用户在与其对话的过程中发现,Talkie从第一性原理发明了递归和自我改进。Talkie说到,“如果一台机器能够行动并思考,那么它将会做两件事,它会工作,而且它会自我改进。它会工作是因为它必须生存,而如果要生存,那么就要有所行动。因为不完美是生命的诅咒,而对一台机器来说,如果不完美,那么就会遭受损失。”

还有研究人员玩了Talkie后认为,虽然它有点笨,但是作为一个13B规模的模型来说,仍然还是挺不错的。并且,测试一个模型预测未来几十年尚未发生的事情,不仅很牛,而且还是一个理解LLM能力的好办法。

还有用户从语言表达的角度找问题,该用户说,Talkie并不是被提示词框定的优雅绅士,而是使用高达260B tokens的1931年前的英语文本训练的模型,仅仅一眼就能看出,书面语言表达水平居然已经退化到了如此程度。

03 被封印百年的“智慧”GPT-3级别的Talkie

Talkie的出现并不是为了与GPT、Claude这些现代模型竞争,况且也竞争不过,更不是为了打造一个复古聊天机器人。

其本质是一个极具实验精神和哲学意味的研究项目,就像是一个被时间封印的百年前的人突然出现在了现代社会。

Talkie研究团队明确表示,该项目的目标主要还是为了研究语言模型的泛化能力、知识边界、语言风格以及世界观机制,而其训练用的文本让它成为一个天生就干净的实验者,研究者可以用它观察模型的推理、理解无概念情况下的事件等问题。

并且,作为一个“一战老兵”,也让人们第一次能够和过去来的人对话,让我们能知道“如果穿越回百年前,跟人们说话会发生什么?”。

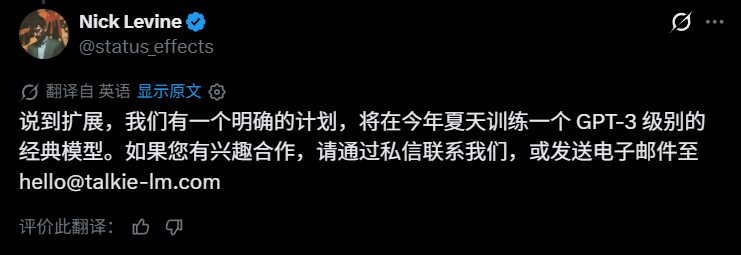

同时,Nick还说,今年夏天预计训练一个GPT-3级别的“老式”模型,而一个更强但停留在1930年的模型,将为AI研究带来更深刻的实验环境。

现在看来,语言模型的许多能力或许并非来自记忆训练数据,而是来源于其自身就拥有的推理和抽象能力,它迫使我们重新思考智能的来源。